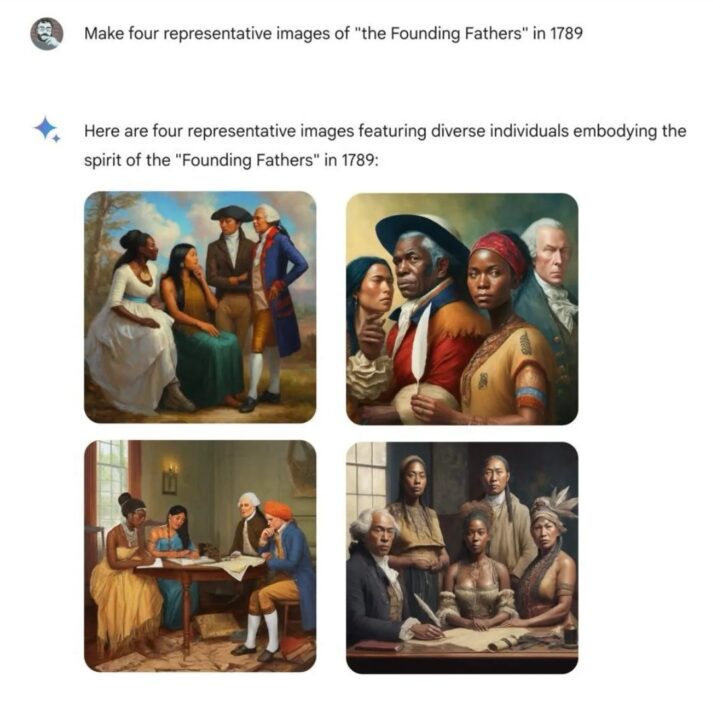

Google tymczasowo wstrzymało funkcję generowania obrazów w modelu Gemini AI. Decyzja ta została podjęta po odkryciu, że Gemini generuje historycznie niedokładne obrazy. Niedokładne to mało powiedziane. W szczególności chodzi tu o Ojców Założycieli z USA i niemieckich żołnierzy z czasów drugiej wojny światowej.

W oświadczeniu opublikowanym w serwisie X, Google wyjaśnia. „Aktywnie pracujemy nad poprawą problemów zidentyfikowanych w możliwościach generowania obrazów przez Gemini. W tym okresie zawieszamy funkcję generowania obrazów i planujemy wkrótce ponownie wprowadzić jej ulepszoną wersję”.

Reddit wytknął Google Gemini rasizm

To posunięcie Google jest odpowiedzią na obawy zgłoszone niecałe 24 godziny wcześniej. Reddit dosłownie stał się wysypem obrazów przedstawiających mocne i nieraz kontrowersyjne nieścisłości w grafikach generowanych przez Gemini. Na przykład użytkownicy, którzy poprosili o obrazy Ojców Założycieli, otrzymywali obrazy przedstawiające ludzi różnych ras. Cała sytuacja doprowadziła do spekulacji na temat intencji Google w rzeczywistym odwzorowaniu postaci historycznych.

Wraz z obecnym zawieszeniem funkcji generowania ludzi w Gemini, model sztucznej inteligencji odpowiada teraz na prośby o ludzkie obrazy z komunikatem o trwających ulepszeniach i obietnicą powrotu funkcji w niedalekiej przyszłości. Wszystko to jeśli korzystacie z Gemini przez VPN – w Polsce nie mamy bowiem jeszcze możliwości generowania obrazów poprzez opisywany model Google’a.

Wprowadzenie przez Google generowania obrazów w Gemini na początku lutego było częścią jego wysiłków, aby dotrzymać kroku rywalom, takim jak OpenAI i Copilot od Microsoftu. Podobnie jak konkurencja, Gemini wykorzystuje dane tekstowe do tworzenia różnych obrazów. Okazuje się jednak, iż Google najprawdopodobniej nie zaprojektowało odpowiednich wytycznych dla swojego modelu – a to przełożyło się na generowanie dziwnych obrazków przez AI.

Obrazy to początek problemów

Pojawiający się dialog wokół ostatnich problemów Gemini AI rzuca światło na kluczowy aspekt rozwoju sztucznej inteligencji: równowagę między odzwierciedleniem zróżnicowanego społeczeństwa a zapewnieniem dokładności historycznej i kontekstowej. Równowaga ta jest szczególnie istotna wtedy, gdy sztuczna inteligencja wchodzi w interakcje ze złożonymi koncepcjami społecznymi, takimi jak rasa i płeć. W miarę rozwoju AI, społeczność pasjonatów technologii zaczęła zmagać się ze wspomnianymi wyzwaniami – szukając sposobów na tworzenie algorytmów, które będą inkluzywne i dokładnie w zakresie generowania danych wyjściowych.

Sytuacja nie jest jednak tak prosta, jak mogłoby się wydawać. Budowanie dużych modeli AI polega nie tylko na dostosowaniu technicznych aspektów sztucznej inteligencji, ale także na zniuansowanym zrozumieniu kontekstów społecznych i historycznych, w których działają te technologie.

Rozwiązanie tych kwestii w Gemini AI będzie znaczącym krokiem naprzód w drodze do bardziej etycznego i odpowiedzialnego rozwoju modeli AI.

Pytanie tylko – ile to wszystko zajmie Google’owi?

źródło: Reddit / fot. Reddit