YouTube poinformował o wdrożeniu pewnych zasad, które mają stanowić podłoże pod regulacje sztucznej inteligencji. Wszystko to ma na celu zminimalizowanie szansy na wystąpienie jakichkolwiek nadużyć. Użytkownicy będą przede wszystkim jeszcze skuteczniej informowani o tym, że konkretny film został wygenerowany przez AI. Łatwiejsze stanie się również zgłaszanie tego typu materiałów. Zerknijmy na wszystkie zmiany nieco bliżej.

YouTube coraz poważniej podchodzi do kwestii AI

Sztuczna inteligencja chyba na dobre zagościła do najpopularniejszych aplikacji oraz usług. Coraz więcej osób korzysta z powszechnie dostępnych asystentów, które nie tylko ułatwiają pracę, ale także stanowią pomoc w codziennych obowiązkach. Dlatego też nie ma nic dziwnego w tym, że największe korporacje podejmują kroki mające na celu uregulowanie zawartości tworzonej przy wykorzystaniu stosunkowo świeżej technologii. Wyjątkiem nie jest pod tym względem Google.

Osoby odpowiedzialne za YouTube opublikowały właśnie dosyć obszerny wpis na oficjalnym blogu. Dotyczy on „podejścia do odpowiedzialnych innowacji w AI”. Na ten moment zaprezentowano kilka nowości, które powinny ujrzeć światło dzienne w najbliższych miesiącach oraz przyszłym roku. Czego dokładnie możemy się spodziewać?

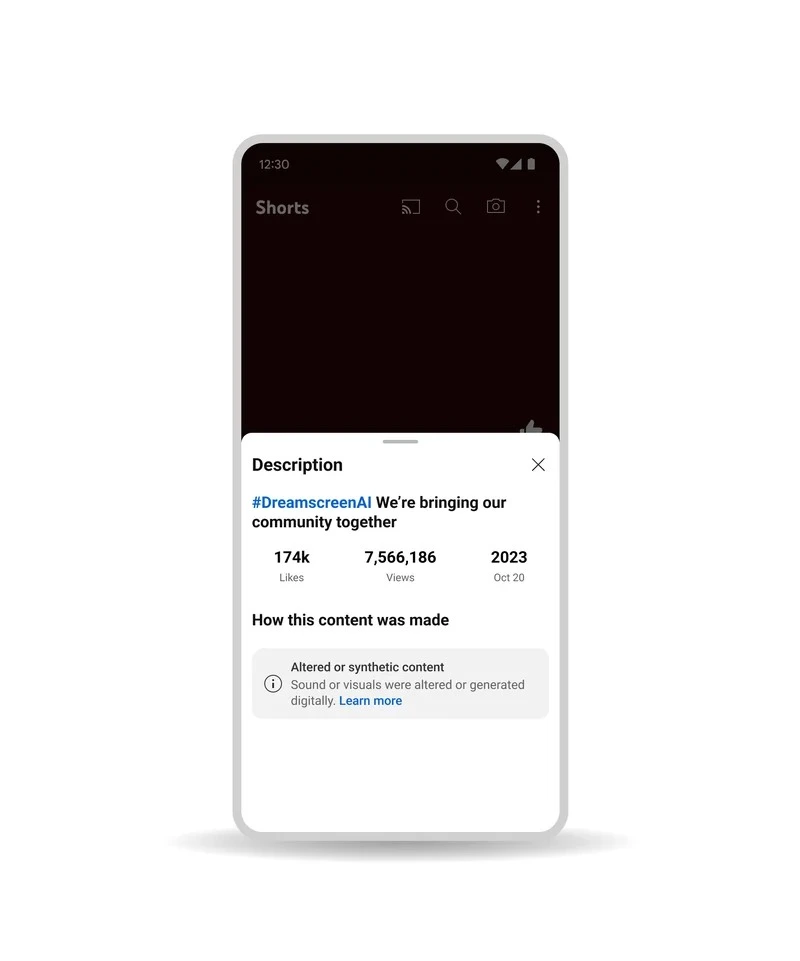

Mowa przede wszystkim o wprowadzeniu zmian pozwalającym na jeszcze skuteczniejsze informowanie widzów, że materiały zostały wygenerowane przez sztuczną inteligencję. Twórcy będą musieli dawać znać, iż dany film zawiera „wiarygodnie wyglądające, ale zmodyfikowane lub sztuczne wygenerowane treści”. Jeśli influencerzy nie zechcą tego robić, to mogą spodziewać się usunięcia zawartości, zawieszenia w programie partnerskim lub innych kar.

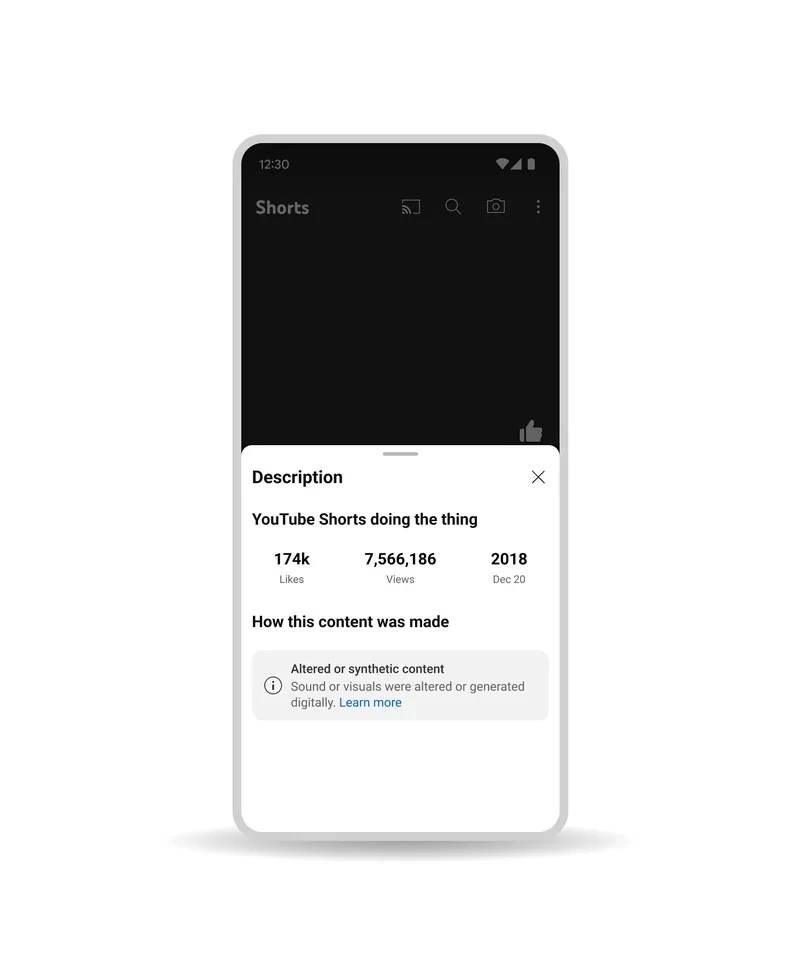

Widzowie przede wszystkim zobaczą nową etykietę nad opisem filmu. Jeśli jednak film poruszać będzie kontrowersyjne tematy, to plakietka pojawi się też bezpośrednio w odtwarzaczu. Ma to zapewnić odbiorcom przejrzystość jeśli chodzi o to, kto stoi za produkcją danego materiału. Oczywiście treści wygenerowane przez AI będą podlegać takim samym zapisom regulaminu, jak te stworzone w stu procentach przez człowieka.

Wygenerowane filmy będą stosownie oznaczone

Twórcy natomiast muszą przygotować się na wdrożenie możliwości przesyłania próśb o usunięcie zawartości „wygenerowanej przez AI lub sztucznie zmanipulowanej w inny sposób, która stwarza pozory ukazywania prawdziwej osoby”. YouTube nie chce bowiem, by ktoś wykorzystywał sztuczną inteligencję do podszywania się pod innych internautów. Może to wyrządzić wiele szkód.

Zespół weryfikacyjny sprawdzi rzecz jasna, czy dany film jest parodią lub satyrą. To samo tyczy się partnerów muzycznych – będą oni mogli zgłaszać prośby o usunięcie wygenerowanych przez AI treści muzycznych „imitujących sposób śpiewania wokalisty lub głos rapera”.

AI może oczywiście okazać się natomiast bardzo przydatną technologią. Ma ona pomagać w szybkim zwiększeniu ilości informacji, które są podstawą do trenowania stosownych klasyfikatorów. Dzięki temu zespół może jeszcze skuteczniej identyfikować i wychwytywać treści niezgodne z regulaminem. To ważna wiadomość, bowiem zwiększona prędkość i dokładność systemów pozwala ludzkim weryfikatorom ominąć potrzebę oglądania wielu szkodliwych treści mogących wywołać traumę czy problemy psychiczne.

YouTube twierdzi również, że to dopiero początek wykorzystywania potencjału generatywnej sztucznej inteligencji. Osoby odpowiedzialne za platformę są pewni, że „w nadchodzących latach transformacja ta odbije się szerokim echem we wszystkich branżach kreatywnych”.

Czas pokaże.

Źródło: YouTube / Zdjęcie otwierające: unsplash.com (@ilgmyzin)