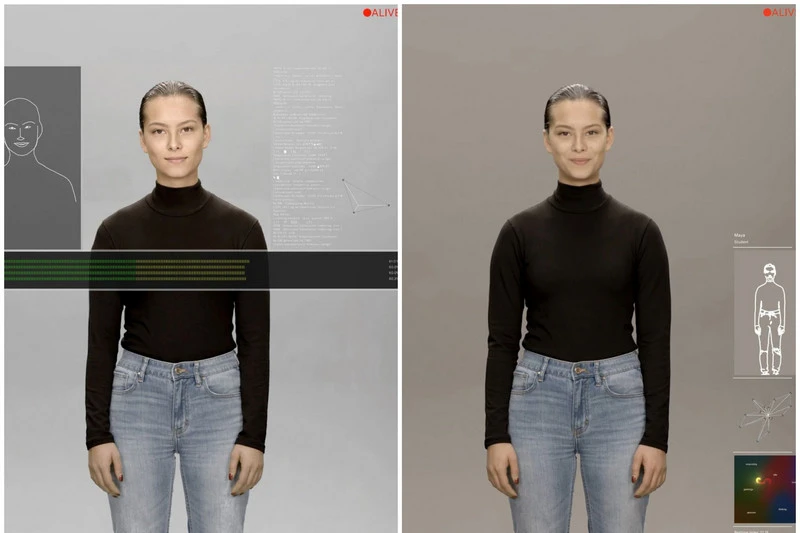

Szef projektu Neon, badacz interakcji człowiek-komputer Paranav Mistry, opublikował tweeta pokazując jeden z awatarów. Samsung twierdzi, że technologia „Core R3” będzie mogła samodzielnie tworzyć nowe wyrażenia, ruchy, dialogi, całkowicie odmienne od oryginalnie przechwyconych danych.

Flying to CES tomorrow, and the code is finally working 🙂 Ready to demo CORE R3. It can now autonomously create new expressions, new movements, new dialog (even in Hindi), completely different from the original captured data. pic.twitter.com/EPAJJrLyjd

— Pranav Mistry (@pranavmistry) January 5, 2020

Niepubliczne wideo pobrane z kodu źródłowego strony internetowej projektu ujawniły jeszcze więcej informacji. Filmy zostały pierwotnie opublikowane na Reddit, a teraz można obejrzeć go na YouTube. Możliwości zaprezentowanej technologii wyglądają naprawdę imponująco.

Niewykluczone, że właśnie tak wygląda przyszłość w wielu branżach. Realistyczne ludzkie awatary będzie można docelowo wykorzystać do celów rozrywkowych i biznesowych w roli przewodników, recepcjonistów i prezenterów telewizyjnych.

Źródło: The Verge