Nowy algorytm jest dziełem badaczy z Uniwersytetu Stanforda, Instytutu Informatyki im. Maxa Plancka, Uniwersytetu Princeton oraz Adobe Research. Ich zdaniem tego typu technologia w przyszłości mogłaby być wykorzystywana podczas produkcji filmowej, w celu unikania konieczności robienia kosztownych dokrętek, chociażby po wprowadzeniu zmian do scenariusza.

Do tej przyszłości jest jeszcze jednak daleko. Możliwości sztucznej inteligencji zespołu są bowiem w pewien sposób ograniczone. W tej chwili program może edytować tylko takie materiały wideo, w których mówca ustawiony jest przodem do kamery.

Jak każda sieć neuronowa, nowy algorytm musiał zostać wytrenowany, aby posiadł omawiane umiejętności. Program wymaga do poznania ruchów twarzy mówcy około 40-minutowego filmu szkoleniowego oraz transkrypcji tego, co w filmie zostało powiedziane. Ten film pozwala algorytmowi na szczegółowe określenie, jaki kształt przybiera twarz danej osoby podczas wymawiana każdej sylaby fonetycznej. Zatem, jeśli chcielibyśmy dokonać z jego pomocą edycji wideo z prezydentem Dudą, musielibyśmy zebrać wcześniej 40 minut materiałów, w których ten by po prostu mówił, z twarzą zwróconą w stronę kamery.

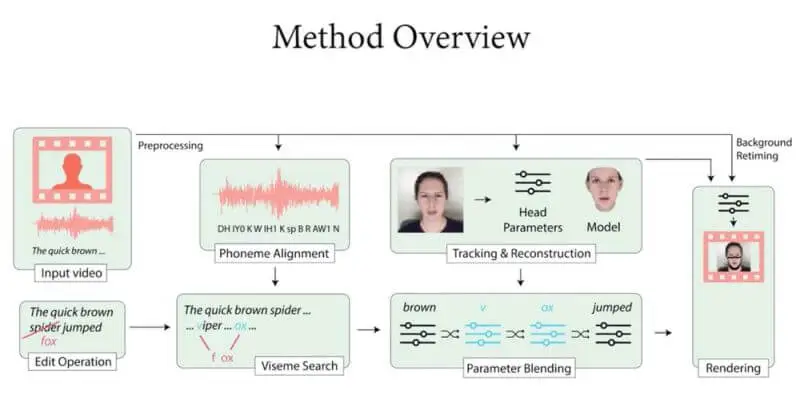

Schemat wyjaśniający działanie algorytmu. | Źródło: Uniwersytet Stanforda

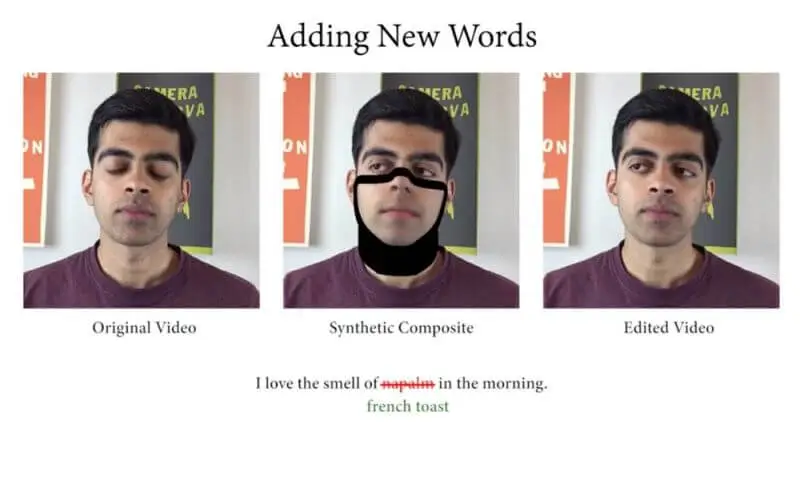

Wytrenowany algorytm, po zmodyfikowaniu przez nas transkrypcji wybranego wideo, tworzy dla poszczególnych klatek trójwymiarowe modele twarzy pasujące do nowych, wygenerowanych sylab. Tutaj wkracza technika uczenia maszynowego zwana Renderowaniem Neuronowym (ang. Neural Rendering), która pokrywa modele 3D fotorealistycznymi teksturami. Dzięki nim wygenerowanych fragmentów twarzy nie można odróżnić od tych rzeczywistych.

Aby algorytm wygenerował nie tylko mimikę odpowiadającą nowej transkrypcji, ale również audio, wystarczy sparować go z oprogramowaniem syntetyzującym mowę. Jednym z programów rekomendowanych przez naukowców jest VoCo. Może on bowiem wygenerować głos, który brzmi niczym rzeczywisty głos mówcy.

Zespół odpowiadający za algorytm zdaje sobie sprawę z tego, że ich dzieło może mieć nieetyczne zastosowania. Dlatego, każdy kto używa jego programu może oznaczać edytowane przez siebie filmy jako fałszywe. Oczywiście, nie jest to żadna przeszkoda dla tych, którzy chcieliby wykorzystać algorytm do niecnych celów. Niemniej, wszelkie wysiłki podejmowane by przeciwdziałać takim procederom są mile widziane.

Źródło: Uniwersytet Stanforda